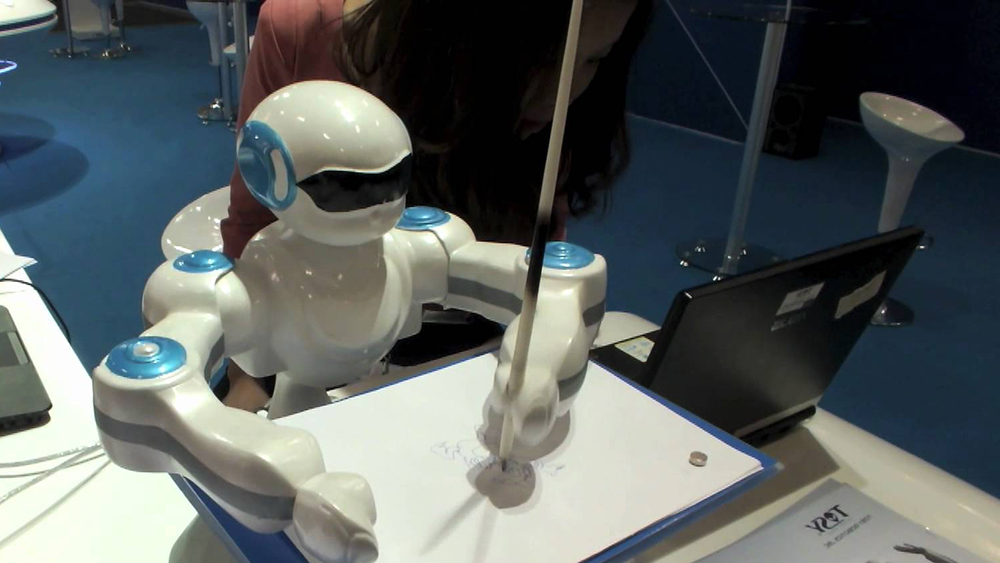

Una de las definiciones de inteligencia artificial (I.A.) considera el modo en que esta lidia con la incertidumbre y la gestiona para la toma de decisiones. Si, por ejemplo, le pides a Waze o Google Maps que tracen una ruta para llegar a algún lugar, sus algoritmos deciden cómo llegar a lo que se considere el mejor resultado posible (la ruta más rápida, con menos tráfico). Si el tiempo estimado de viaje resulta inexacto o la aplicación te sugiere una ruta que no te parezca muy buena, las decisiones tomadas paran ahí y no hay mayor consecuencia. El problema viene cuando la inteligencia artificial, como agente autónomo, toma decisiones que sí pueden afectarte. Por ejemplo, un robot cuidador que cometa un error y no envíe una alerta en caso de que el adulto mayor se caiga o, por alguna falla, no emita el recordatorio para que tome su medicina. ¿La responsabilidad en estos casos siempre podrá ser trasladada al fabricante?

Estamos presenciando el surgimiento de nuevos agentes autónomos. ¿Cuenta la ley con recursos suficientes para hacer frente a los potenciales conflictos que puedan surgir respecto de la actuación de las inteligencias artificiales, o será necesario otorgarles personalidad legal?

No es nuevo que se le conceda personalidad a entes no humanos: las personas jurídicas (los diferentes tipos de sociedades) son ficciones legales que cuentan con ella. Esto se da con la finalidad de que exista claridad en los derechos y obligaciones que les corresponden. Tanto una persona física como una sociedad cuentan con personalidad, aunque con atributos distintos; por ejemplo, una sociedad no tiene estado civil, pero sí nombre, domicilio y nacionalidad, entre otros.

Apenas el 27 de enero de este año, el Parlamento Europeo emitió una Propuesta con recomendaciones destinadas a la Comisión de normas de Derecho Civil sobre Robótica. En este documento expone que la determinación de responsabilidad civil por el daño que, en su caso, puedan causar los robots es un asunto crucial que debe ser abordado para brindar certeza a los consumidores y a los negocios. El reto es grande: se pretende crear un instrumento legislativo relativo al desarrollo y uso de robots e inteligencias artificiales combinado con códigos de conductas y lineamientos. Y aunque todavía no hay nada hecho, la idea es que ni la responsabilidad ni las compensaciones se limiten por el solo hecho de que haya sido un robot el causante de los daños. Por lo pronto, la responsabilidad debe recaer en la persona humana que programó al robot. El tejido fino en este tema vendrá en lo que el Parlamento menciona como proporcionalidad entre la responsabilidad y las instrucciones y el grado de autonomía del robot; es decir, a mayor autonomía y entrenamiento, mayor responsabilidad para el entrenador. Esto es con la finalidad de que la autonomía no sea un pretexto para deslindarse de responsabilidad únicamente por cuanto hace a las habilidades que quien lo programa le enseña al robot.

Otras habilidades, las que dependen de su capacidad de autoaprendizaje, no quedarían dentro de este esquema de responsabilidad. Una de las diferencias fundamentales entre humanos y robots es que estos solo pueden hacer aquello para lo que están programados, pero con el autoaprendizaje pueden improvisar, como cuando un niño manipula un juguete nuevo sin instrucciones previas. Entre las soluciones que se ponen a la mano para la dilucidar la responsabilidad de las I.A. está la contratación de seguros en los que se tome en consideración todas las posibles responsabilidades, y no únicamente las fallas en el producto o fallas humanas, como ocurre en el caso de los seguros para automóviles. Así que será cuestión de los seguros inventar nuevos productos para cubrir este mercado. Y lo más probable es que esto ocurra antes de que se emita cualquier regulación.

Otra de las propuestas es dotar a los robots del status de “persona electrónica”, para hacerlos responsables de cualquier daño o reconocer un bien que puedan hacer. Esto aplicaría a robots con alto grado de autonomía. ¿Se imaginan medallas al mérito o de héroes de guerra para robots? Por el otro lado, ¿cuál sería el efecto de hacer responsable a un robot?, ¿sería suficiente o necesario programarlo para arrepentirse?.

Con el autoaprendizaje y el avance en la autonomía entramos en terrenos más complicados. Si en el afán de que los robots entiendan y aprendan, de pronto adquieren consciencia (la famosa singularidad), ¿les reconoceremos algún derecho? ¿Tener derechos le haría sentido a una inteligencia artificial? Los detractores afirman que no, porque un derecho se refiere al goce de algo (la vida o la salud, por ejemplo) cuya privación causa sufrimiento o tensión. Dado que una A.I. no tiene la capacidad de sufrir ni disfrutar, no tiene sentido reconocerles derecho alguno. También están quienes exploran la posibilidad de los derechos post-humanos para las A.I. ¿Será posible programar el goce o el sufrimiento, o esperamos que surjan espontáneamente, con la tan esperada y a la vez temida consciencia robótica? Si eso pudiera programarse, ¿qué hay de la dignidad, elemento toral de los derechos humanos? ¿También la vamos a programar?

Nació el mismo año que se estrenó Blade Runner. Abogada, especialista en tecnología y protección de datos.