La recolonización de los museos

La nueva museología y la museología crítica amenazan la autonomía del arte. Pretenden ponerlo al servicio de políticas teñidas de moralina: el juicio del espectador y la crítica son…

Damien Hirst: el espectáculo, el arte, el presente mediático

Las piezas que conforman la exposición de Damien Hirst encarnan un comentario respecto a la espectacularidad, la ironía y la fama. Debajo de…

La visión cósmica de Pearl Jam

Dark matter es un disco de madurez y resurrección, en el que Pearl Jam responde al fatalismo de la entropía con energía transformadora, en…

El debate por la seguridad

El Estado falla frente al crimen organizado en todo México, pero de manera distinta en cada…

¿Referéndum de autodeterminación?

La única vía sólida para salir de la profunda crisis territorial que vive España es afrontar…

“Habitar lo feo es muy importante para las mujeres”. Entrevista a Ute Wassermann

Hija de movimientos artísticos gestados en la década de los 60 y 70, como el happening, el…

Johnny Guitar o del cine de culto

Obra de culto admirada por Wenders y Truffaut, "Johnny Guitar" es ejemplo del lúcido…

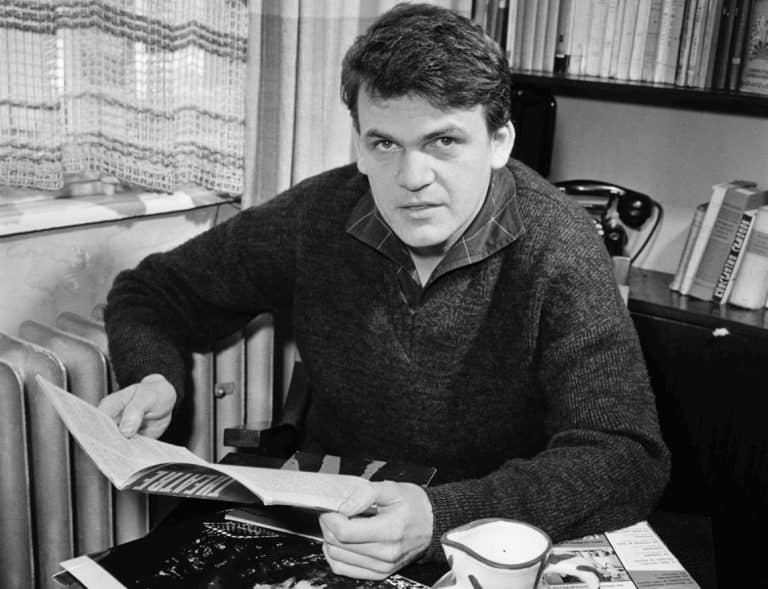

MILAN KUNDERA, 1929-2023

En LA EDICIÓN DEL MES

El nacimiento de una escritora

Caja 19 es una novela que es ensayo a la vez y cuya apuesta de estilo es rotunda y coherente…

Lección estética

Esta novela de Landero, la decimocuarta de su catálogo y la más corta con la excepción…

Manual de supervivencia a la Inteligencia Artificial

La avalancha de informaciones, alarmas y opiniones sobre la Inteligencia Artificial genera…

El libro de las enfermedades liberales

El ensayo Liberalism against itself: Cold war intellectuals and the making of our times, de…

CRÍTICA

Ritmo en todo y en todos

El libro de Ce Santiago contiene una historia de la batería como instrumento, con un…

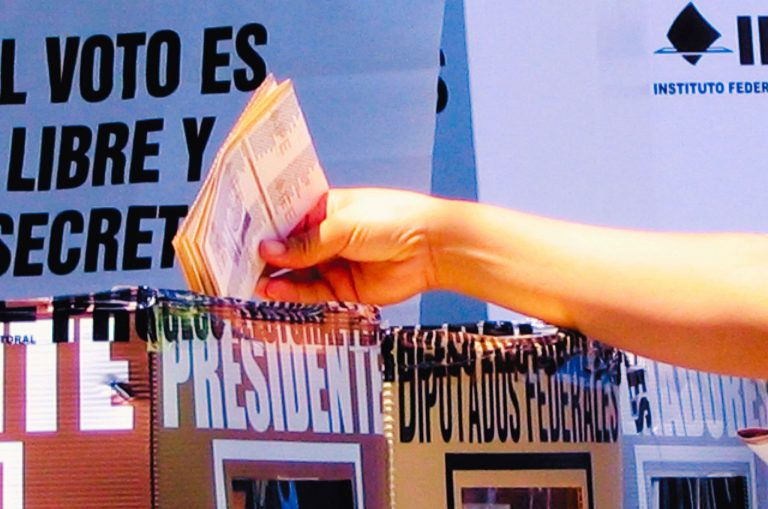

La derrota de la izquierda independiente

En <i>Las dos izquierdas</i>, Jorge Castañeda y Joel Ortega dan cuenta de dos formas en que…

“Ucrania ha pasado a ser el lugar en el que se decide no solo el destino de un país en concreto, sino el de toda Europa.”

Conversaciones

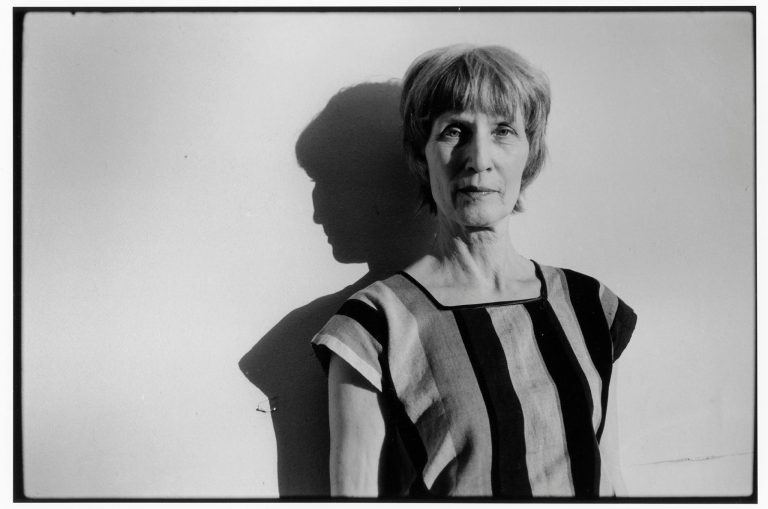

“Habitar lo feo es muy importante para las mujeres”. Entrevista a Ute Wassermann

Hija de movimientos artísticos gestados en la década de los 60 y 70, como el happening, el…

Eduardo Halfon: en la ambigüedad se asoma la verdad

Consciente de la avidez que los lectores tienen hacia la literatura autobiográfica, el…

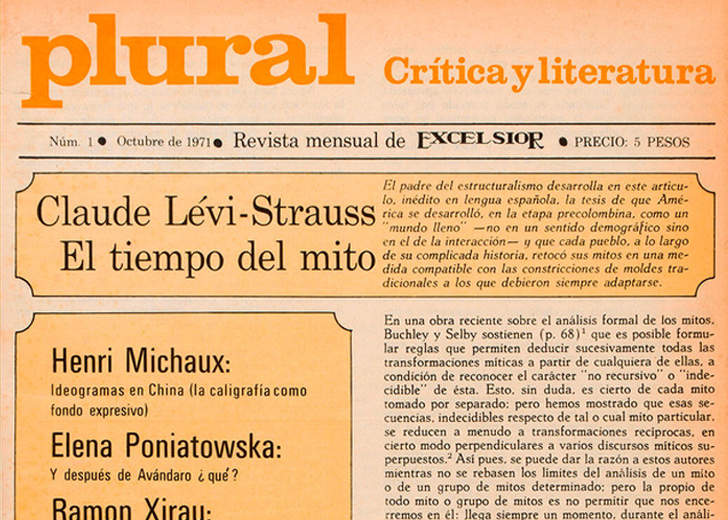

“Revistas, para que la conversación no cese”. Entrevista a Malva Flores

Editora, poeta y ensayista, Malva Flores habla aquí acerca de Péndola, un sitio web dedicado…

“Es imposible aumentar el bienestar si tenemos un medio ambiente que se deteriora”. Entrevista a Julia Carabias

Las consecuencias de la acción humana en el planeta son inocultables. Pero la reconocida…

Ensayos

Los cahuilla

Los cahuillas habitan el sur de California, pero apenas el 1% habla su lengua. No han…

Ortega y Gasset, periodismo y filosofía

Ignacio Blanco cuenta la evolución de la carrera periodística del Ortega al hilo de los…

La mayor resistencia

En La menor resistencia, su película de 1981, Fischli y Weiss vestían dos…

La boda de Elena Garro y Octavio Paz

Sobre la pareja que formaron Elena Garro y Octavio Paz se han tejido múltiples ficciones.

creación

Nada es verdad (fragmento)

Un fragmento de la novela "Nada es verdad", de la escritora italiana Veronica Raimo, que…

Poemas

Llamador de ángeles El viento mueve los envases de plásticoensartados en las varillas de casas a medio construir. Pienso en el choque de los pedazos de maderade un llamador de ángeles. Pienso en un búngalo…

Distopía mexicana

¿Qué hubiera pasado de ganar AMLO las elecciones de 2006? Fernando García Ramírez lo imagina.