La cultura pop se ha convertido en un oligopolio

Un cártel de superestrellas ha conquistado el cine, la literatura y la música. ¿Cómo ha ocurrido y qué podemos hacer al respecto?

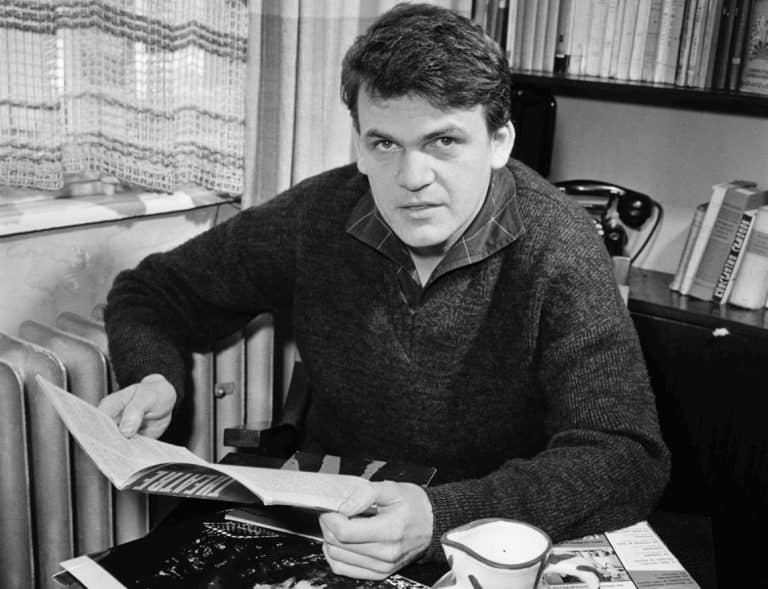

Byron, el peregrino eterno

Se cumplen 200 años de la muerte de Lord Byron (1788-1824), uno de los grandes poetas del Romanticismo inglés y todavía hoy una figura controvertida.

Una risa incómoda ante la historia de la dictadura argentina

Desde el teatro y el performance, artistas como Félix Bruzzone y Mariana Eva Pérez buscan nuevas miradas al horror de la dictadura y las…

La derrota de la izquierda independiente

En <i>Las dos izquierdas</i>, Jorge Castañeda y Joel Ortega dan cuenta de dos formas en que…

El vencedor vencido, un viaje a las tinieblas de Hernán Cortés

Enrique Serna debuta como libretista en la más reciente ópera de Federico Ibarra, que narra…

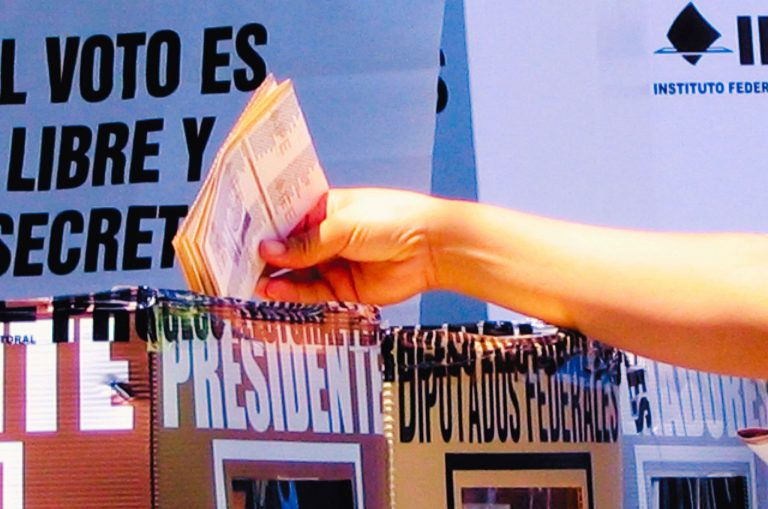

Venezuela: dilemas de votar en dictadura

Nicolás Maduro no tiene oportunidad de ganar una elección mínimamente limpia, pero ha…

Huellas de golpes de Estado, en Ambulante 2024

Dos de los mejores filmes programados este año en Ambulante presentan, desde distintas…

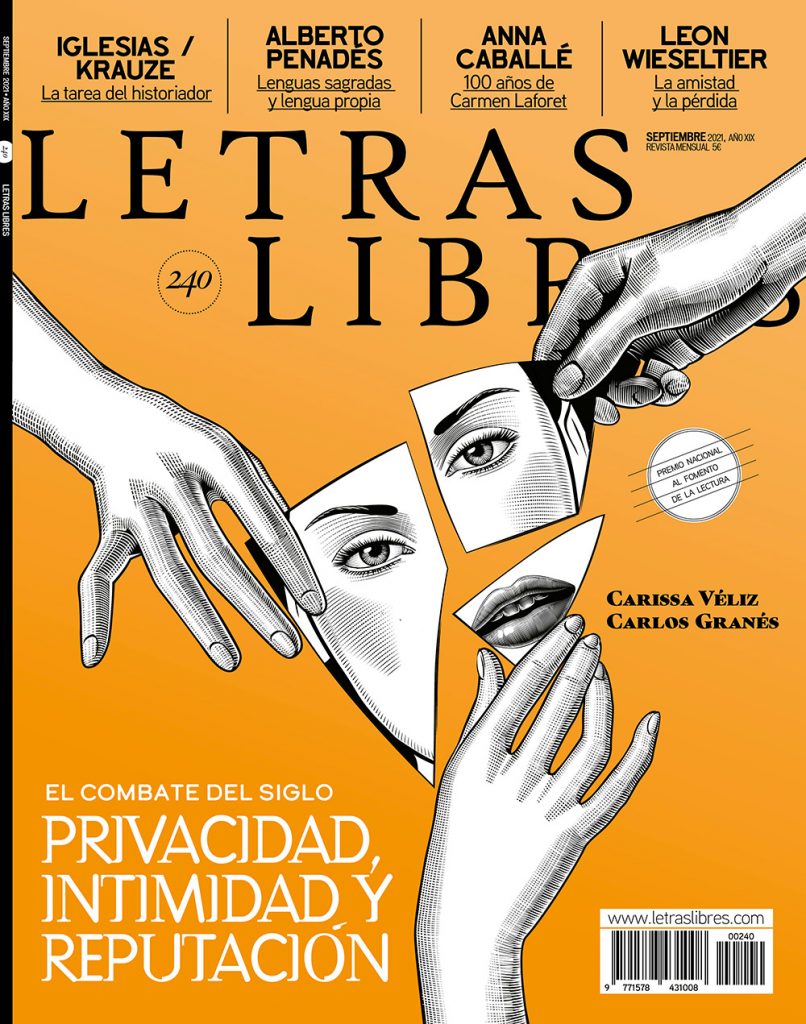

En LA EDICIÓN DEL MES

Lección estética

Esta novela de Landero, la decimocuarta de su catálogo y la más corta con la excepción…

El libro de las enfermedades liberales

El ensayo Liberalism against itself: Cold war intellectuals and the making of our times, de…

Diario breve de una visita a Hollywood

El glamur y la cutrez, los mendigos y las estrellas, la noche de los Óscar y la búsqueda de…

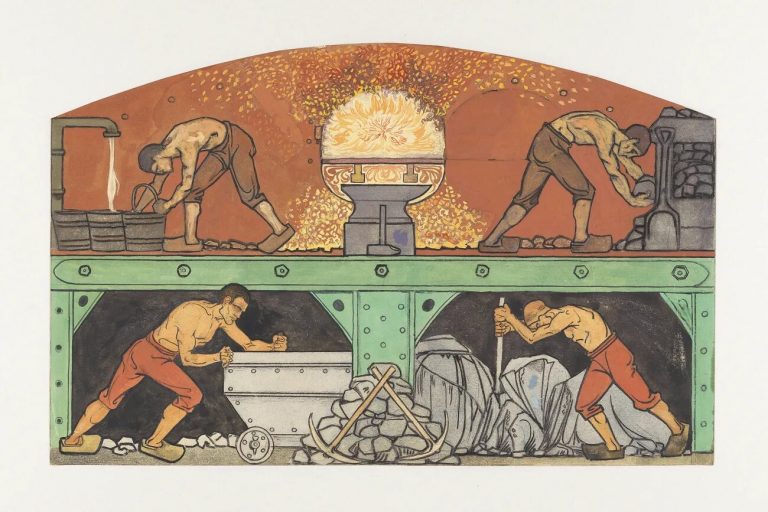

La recolonización de los museos

La nueva museología y la museología crítica amenazan la autonomía del arte. Pretenden…

CRÍTICA

Vivir en trance

<i>Última carta a un lector</i> ofrece un excelente punto de partida para explorar uno de…

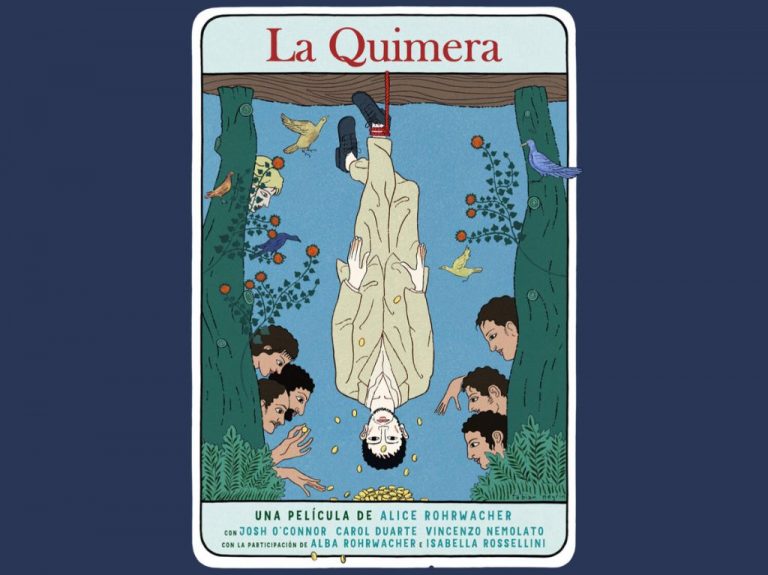

La quimera, sobrecogedora y vital

La cuarta película de Alice Rohrwacher es alegre y triste, explosiva y sobrecogedora.

“Ucrania ha pasado a ser el lugar en el que se decide no solo el destino de un país en concreto, sino el de toda Europa.”

Conversaciones

“Revistas, para que la conversación no cese”. Entrevista a Malva Flores

Editora, poeta y ensayista, Malva Flores habla aquí acerca de Péndola, un sitio web dedicado…

“Es imposible aumentar el bienestar si tenemos un medio ambiente que se deteriora”. Entrevista a Julia Carabias

Las consecuencias de la acción humana en el planeta son inocultables. Pero la reconocida…

“Vivimos un tiempo de finales.” Entrevista a Patricio Pron

Una conversación con el autor argentino a propósito de su novela <i>Naturaleza secreta de…

“El Ejército es un mal agente económico.” Entrevista a Isabella Cota

Una conversación con la periodista a propósito de su libro "Suerte o desastre", un balance…

Ensayos

Los cahuilla

Los cahuillas habitan el sur de California, pero apenas el 1% habla su lengua. No han…

Ortega y Gasset, periodismo y filosofía

Ignacio Blanco cuenta la evolución de la carrera periodística del Ortega al hilo de los…

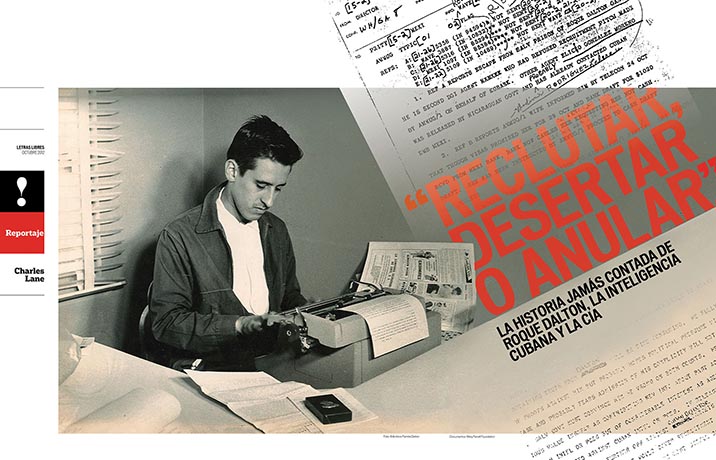

Sobre “La historia jamás contada de Roque Dalton” (núm. 166)

Estimado director: Como coautora del libro El asesinato de Roque Dalton. Mapa de un…

Ciencia y filosofía

¿Tiene la ciencia algo que decir sobre materias clásicas de la filosofía como…

creación

Poemas

Llamador de ángeles El viento mueve los envases de plásticoensartados en las varillas de…

Distopía mexicana

¿Qué hubiera pasado de ganar AMLO las elecciones de 2006? Fernando García Ramírez lo imagina.

Jardín abierto

Ondulaciones meandros del agua al…